10.1 Elementos de calibración.

La calibración de una cámara es el primer paso para la solución de aplicaciones donde es necesario obtener datos cuantitativos de la imagen. Aunque es posible obtener información de la escena a partir de imágenes tomadas sin calibrar cámaras, el proceso de calibración es esencial cuando se trata de la obtención de mediciones del mismo.

Una calibración exacta de la cámara permite obtener distancias del mundo real a partir de imágenes tomadas de la misma. Con esta información es posible resolver aplicaciones de ensamble de partes industriales, evitar obstáculos en la navegación de un robot, controlar un brazo robótico o desarrollar la planificación de una ruta de trabajo. Si por el contrario nos centramos en la reconstrucción 3D de objetos, cada punto de la imagen determina un haz óptico el cual pasa por el centro óptico de la cámara en escena. La gestión de múltiples imágenes de la misma escena en la que no hay movimiento, se puede relacionar con los dos haces ópticos para la posición de los puntos 3D en la escena.

En este caso es necesario resolver el paso anterior de correspondencias de un objeto en diferentes imágenes. Una vez que ha sido posible realizar la reconstrucción 3D del objeto, puede ser comparado con un modelo almacenado para determinar el resultado de imperfecciones en el mismo proceso de manufactura, lo que implica que una mejora significativa no puede sobre la inspección humana.

Técnicas para la calibración de la cámara.

Haz clic en cada concepto para ver a detalle.

La calibración fotogramétrica se realiza por la observación de patrones cuya geometría en un espacio 3D es conocida con un buen nivel de precisión. Los patrones estándares de calibración están normalmente posicionados en dos o tres planos ortogonales entre ellos. En algunos casos, sólo se maneja un único plano, cuya translación es bien conocida. Este tipo de calibración requiere una configuración compleja, pero sus resultados son eficientes.

Este método se basa en el movimiento de la cámara de observación de una escena estática mientras viaja utilizando sólo la información de la imagen. La rigidez de la escena generalmente impone restricciones sobre los parámetros de la cámara. Tres imágenes adoptadas por una sola cámara con los parámetros intrínsecos son suficiente para los parámetros intrínsecos y extrínsecos, aunque esta técnica es muy flexible, no está maduro todavía.

El modelo de cámara tradicionalmente usado para pasar coordenadas reales 3D a coordenadas reales 2D pertenecientes a la imagen capturada, por lo general se utiliza el modelo de proyección en perspectiva llamado modelo pinhole. En este modelo todos los rayos de un determinado objeto pasan a través de un fino agujero para impactar el sensor de imagen. Dado que los lentes no tienen este comportamiento lineal, el modelo de orificio en aguja de alfiler (pinhole) debe ser corregido con un valor de distorsión, es decir, debe ser complementada con los parámetros que corrigen su comportamiento y enfoque ideal, en la medida de lo posible, proporcionar el comportamiento real del objetivo. El sistema de referencia de la cámara se coloca en el centro de la proyección, el eje z, coincidiendo con dicho sistema con el eje óptico, también llamado eje axial. En esta disposición de ejes, el plano de la imagen de coordenadas u, v, se encuentra a una distancia igual a la longitud focal de la distancia de la lente perpendicular al eje óptico. La intersección del eje de la óptica con el plano de la imagen se llama el punto principal. El centro de proyección de la cámara C se supone constante, pero es un desconocido priori. El plano de la imagen es por lo general colocado en frente del centro de proyección C para tomar una fotografía sin inversión.

El problema consiste en encontrar y resolver un modelo matemático de cómo la cámara ve la escena. Entiéndase por resolver al proceso de hallazgo de un conjunto de valores denominados parámetros, por lo que por este procedimiento permiten obtener información tridimensional a partir de imágenes.

Debido a que se obtienen los parámetros de calibración que participan en el proceso de formación de imágenes, a continuación, la calibración es el proceso por el cual se da la relación entre las coordenadas tridimensionales de los objetos en el entorno con los correspondientes proyecciones de imágenes bidimensionales fijados.

Técnicas de acuerdo con el destino de calibración

Dependiendo del objeto que se utiliza para calibrar, puede resaltar dos tipos de calibración, coplanares y no coplanares.

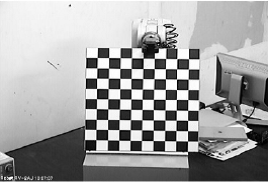

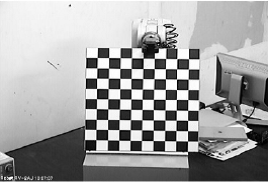

- Coplanar: El objeto utilizado es plano, con un patrón impreso que se llama cuadrícula de calibración, por ejemplo el que se muestra en la siguiente figura:

Imagen obtenida de http://gdsproc.com/congreso/capacho_stsiva_2010_1.pdf Sólo para fines educativos

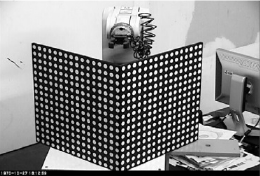

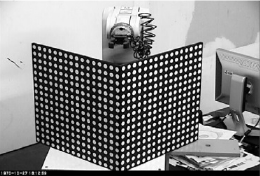

- No Coplanar: El objeto utilizado es típicamente un cubo, en donde las diferentes caras son el mismo patrón impreso o una rejilla compuesta de dos planos, cada uno con el mismo patrón como el que se muestra en la siguiente figura. Un objeto de puntos de posiciones conocidas tridimensionales se conocen como puntos de calibración.

Imagen obtenida de http://gdsproc.com/congreso/capacho_stsiva_2010_1.pdf Sólo para fines educativos

10.2 Ajuste de enfoque manual y automático.

Calibración manual.

Las cámaras o sensores de imagen son los elementos responsables de la captura de información de escenas de luz y transmiten al equipo como señal analógica o digital. Una vez que la imagen ha sido tomada por la cámara de video, la tarjeta de adquisición de datos y el procesador de imágenes reciben la señal analógica enviada por él, para convertirla en una señal digital para su procesamiento.

La calibración de una cámara es una necesidad de las mediciones de la escena a partir de imágenes en el mismo paso. La precisión de la calibración posteriormente determina la precisión de las mediciones que se hacen a partir de imágenes. Es por esta razón por la que es esencial calibrar la cámara con plenas garantías de que los parámetros obtenidos son más cercanos a los valores reales. Este compromiso implica la elección de un método de ajuste de calibración y el uso adecuado de los mismos.

Hay diferentes métodos de ajustes manuales, así como distintas formas de clasificarlos. En esta sección se referencia algunos de los métodos que comúnmente se utilizan:

Método Tsai.

Método de Tsai representa un proceso de calibración clásico basado en mediciones de coordenadas de puntos de una plantilla 3D con relación a un punto de referencia fijo. Esto muestra excelentes resultados, una sola imagen de la calibración que se requiera, aunque se necesita una precisión significativa de entrada de datos para alcanzarlos.

El método de Tsai obtiene un parámetro de cámara preciso si los datos de entrada están ligeramente contaminados con estimación de ruido. Teniendo en cuenta que se necesitan al menos un centenar de puntos en la plantilla y las coordenadas debe ser referido de manera fija a las coordenadas del origen, además de la orientación y la posición de la cámara con referencia a los ejes de coordenadas, estos parámetros son: Rx, Ry y Rz representan a ángulos de rotación entre los ejes de transformación absolutos y Tx, Ty y Tz son los componentes del vector de translación para la transformación entre los ejes de la cámara y las coordenadas del sistema absoluto.

Adicionalmente, cinco parámetros intrínsecos relacionados con las constantes de la cámara que se sabe son necesarios, porque no es suficiente con mirar la información que el fabricante proporciona y que la cámara debe suministrar. Estos otros parámetros constantes son:

NCX, número de elementos sensores en la dirección horizontal; Nfx, el número de pixeles en la dirección horizontal de la cámara; dx, anchura de cada parte del sensor de la cámara (mm = el); dy, alta de cada elemento del sensor de la cámara (mm = el); dpx, anchura efectiva de un pixel en la cámara (mm/pix); dpy, altura efectiva de un pixel en la cámara (mm/pix).

La plantilla 3D consiste de dos o tres planos ortogonales entre sí, lo que conduce a una tarea laboriosa y costosa para llevar a cabo, teniendo en cuenta que es esencial para el diseño adecuado de la calibración, así como una medición exacta de las coordenadas de los puntos, para obtener buenos resultados al final del procedimiento. Sin embargo, la posibilidad de errores en las mediciones son altos. A continuación se presenta una imagen en 3D que muestra una plantilla que se utiliza para este método de calibración.

Imagen obtenida de https://www.frc.ri.cmu.edu/projects/mars/stereo.html Sólo para fines educativos

Método Zhang

Zhang propone una técnica de calibración basado en la observación de un blanco plano de varias posiciones. Este método utiliza las coordenadas de los puntos dentro de la plantilla plana en 2D tomando diferentes imágenes de la misma a partir de diferentes posiciones y orientaciones. Así, las ventajas de los métodos de calibración sobre la base de mediciones de las coordenadas de la plantilla con las ventajas de la autocalibración, en la que no es necesario el uso de una plantilla combinada. Este modo de calibración es muy flexible desde el punto de vista de la cámara y la plantilla se puede mover libremente y puede tomar tantas fotos como quieras sin tener que realizar mediciones en la plantilla.

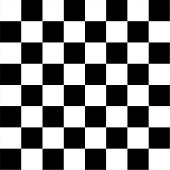

La plantilla 2D no requiere una plantilla de diseño especial, ni como medición precisa de sus puntos. Por otra parte, el algoritmo de calibración de la sensibilidad a los errores en las mediciones se puede mejorar aumentando el número de puntos en la plantilla, simplemente imprimiendo un tablero de ajedrez con más esquinas.

Calibración automática.

Estas técnicas no utilizan objetos de calibración, ya que sólo es necesario relacionar un punto en diferentes imágenes. Sólo por mover la cámara en una escena estática la rigidez de la escena global provoca dos restricciones dentro de los parámetros de la cámara intrínseca. Por lo tanto, existen varias imágenes de la misma escena en los mismos parámetros intrínsecos, la correspondencia entre tres imágenes son suficientes para calcular tanto los parámetros intrínsecos y extrínsecos.

En estos casos incluso una plantilla no es necesaria, es necesario calcular un gran número de parámetros, lo que resulta en un complejo problema matemático. Debido a la dificultad para iniciar la búsqueda, los métodos de autocalibración tienden a ser inestables. Sería necesario considerar la familia de algoritmos que modelan los parámetros que el modelo de distorsión causada por la lente en la imagen sin necesidad de utilizar objetos de calibración, y por lo tanto, sin saber nada de la estructura 3D.

Estos métodos confían en que una proyección en perspectiva ideal permite que la cámara transforme líneas rectas en el espacio 3D en línea recta dentro del espacio de la imagen 2D correspondiente. Por este motivo, el refuerzo de la linealidad de las partes de las curvas de imagen son consecuencia de la distorsión de los lentes de la cámara, es posible determinar la deformación que está produce. Hay métodos que utilizan limitaciones epipolares y trilineales entre pares y tripletes de imágenes respectivamente para estimar la distorsión radial.

La elección de la calibración automática es debido a varias razones:

- Simplicidad de aplicación: sólo es necesario realizar múltiples capturas de un objeto familiar, de modo que varía su posición a través de una serie de fotografías.

- Validación de resultados: los datos obtenidos después de la calibración son tan buenos como los obtenidos con otros métodos, sin un alto costo computacional o equipos costosos requeridos.

Procedimiento de calibración.

Un paso esencial en la triangulación 3D con sistemas SL es su calibración, es decir, la determinación del interior de la orientación (distancia focal, posición del punto principal, parámetros de distorsión de la lente) del proyector de video y cámara digital, así como su posición relativa en el espacio (escala). Típicamente, una calibración de la cámara-proyector se lleva a cabo en dos pasos separados.

En primer lugar, la orientación interior de la cámara se estima, y el lado interior del proyector y orientación relativa son encontrados. En este contexto, utilice una superficie plana y una combinación de puntos de control circulares impresos y proyectando objetivos para realizar la calibración basada en el plano. Luego, usando la restricción epipolar, homologías entre el proyector y los píxeles de la cámara se establecen y el proyector se calibra. En la cámara se calibra y luego se realiza un escaneo completo de barrido SL de un objeto plano que contiene objetivos para obtener correspondencias entre el proyector y los píxeles de la cámara.

Este procedimiento se repite con diferentes orientaciones de la superficie plana, y sintetiza imágenes de las cuales el proyector podría calcular como una cámara virtual las cuales se calculan y se utilizan para su calibración. Finalmente, adopta la misma técnica de proyector de imágenes virtuales, a la vez que se propone un enfoque alternativo, en el cual una configuración calibrada de cámara con estéreo se utiliza para calcular las coordenadas 3D de un patrón proyectado en diferentes orientaciones del objeto plano; las coordenadas 3D adquiridas se utilizan en una etapa posterior de calibración del proyector.

Entonces, antes de la aplicación que permite el paso de calibración se ha requerido el uso de puntos en el tablero. Este objeto de calibración sigue un patrón simple de elipses negras, que permiten que el algoritmo funcione e identifique regiones con el software integrado.

10.3 Distancia de trabajo.

En visión estereoscópica, la distancia de trabajo para un punto en particular entre las imágenes obtenidas de dos cámaras es usada para calcular profundidad. Para ello es necesario que ambas cámaras estén debidamente alineadas, no sólo paralela una a la otra y a la línea entre ellas sino también coplanares, pero si la calibración no es buena se pierde precisión en la percepción de la profundidad.

Al identificar pares de puntos de cada imagen correspondientes al mismo lugar y la misma distancia (en pixeles) entre ellos, determina la profundidad con alta precisión. Un ejemplo es una cámara montada en una vía que puede moverse de un lado a otro. Hay una línea perpendicular a la vía, sin embargo, puede haber un ángulo de inclinación o una rotación de orientación. El eje de rotación es la línea perpendicular al plano formado por la línea de rotación de orientación y por la línea de rotación de ajuste.

Una cámara bien calibrada tendría α=β=0, es decir, tendría un eje de rotación perpendicular al plano de la vía. En el caso de dos cámaras, no sólo α y β equivalen a cero, sino también ץ . En visión por computadora es muy importante el concepto razón de longitud de píxel foco o longitud, o f/p, donde f es la distancia focal y p es la medida de cada pixel. La razón f/p relaciona los parámetros de la imagen formada dentro de las lentes y la imagen del mundo exterior.

Para finalizar, debemos saber que conocidas todas las partes de un objeto, llega el tiempo de determinar la selección del lente ideal para una aplicación disponible, utilizando las siguientes características para la correcta selección de la longitud del foco.

b= Tamaño del sensor CCD

B= Anchura del objeto

F = Distancia focal

D = Distancia de trabajo

C = Factor de conversión del tamaño del sensor