6.1 Características principales de los sistemas de visión

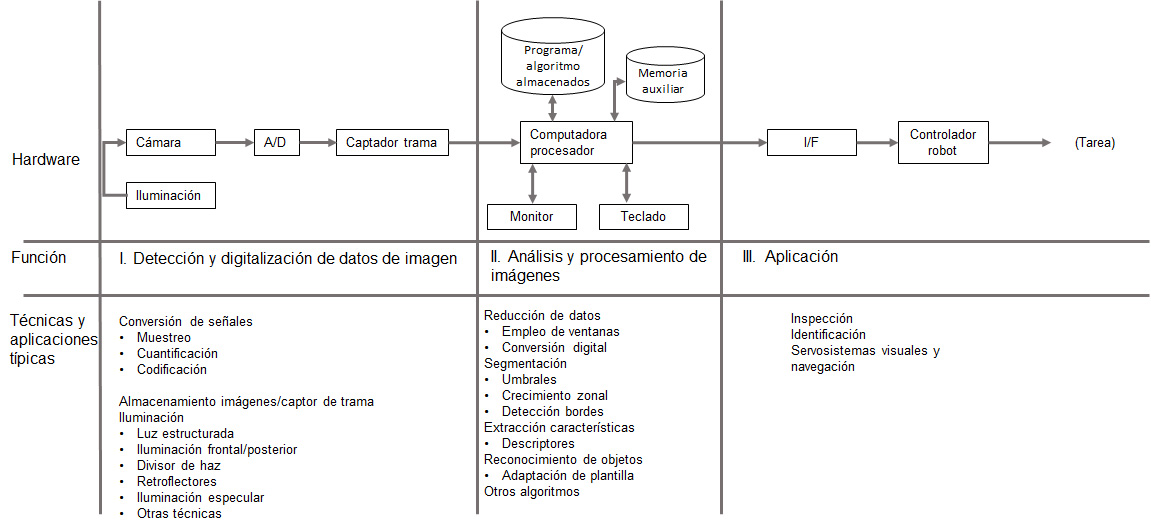

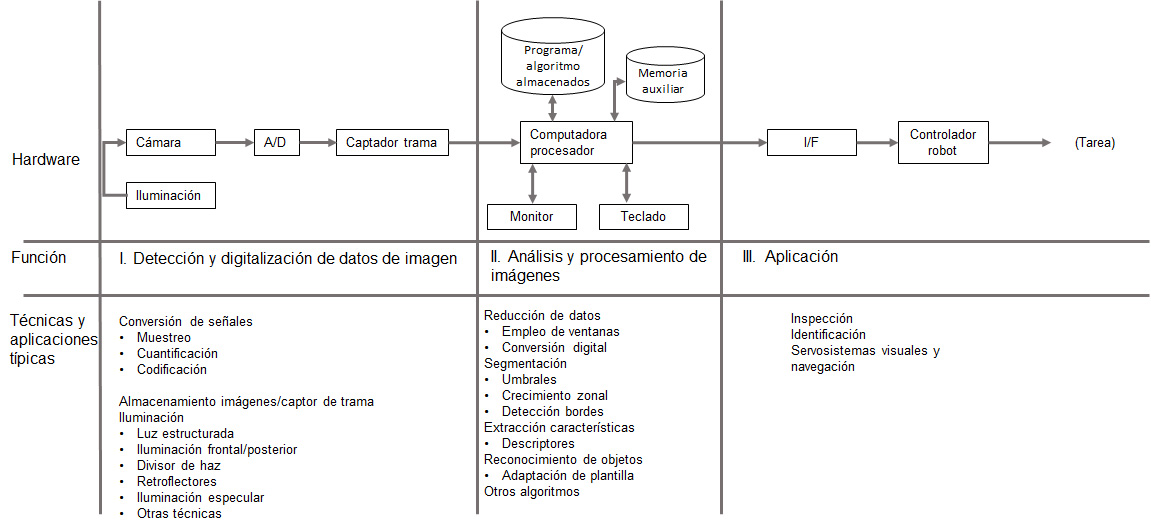

Los sistemas de visión hacen referencia a la detección de datos de visión y su interpretación por una computadora. Éste se encuentra constituido básicamente por una cámara y equipos de digitalización, una computadora digital y los elementos de hardware y software necesarios para su interconexión. Esto último se suele referir a un preprocesador. Las tres características principales para el funcionamiento de un sistema de visión son los siguientes:

- Detección y digitalización de datos de imagen

- Análisis y procesamiento de imágenes

- Aplicación

Las relaciones entre las tres funciones se ilustran en el diagrama siguiente:

Groover, M., Weiss, M, Nagael, R. y Odrey, N. (1995). Industrial Robotics Technology, Programming and Applications. EE. UU: McGraw Hill.

Las funciones de detección y digitalización implican la entrada de datos de visión por medio de una cámara enfocada en la escena de interés. Se emplean técnicas de iluminación especiales para obtener una imagen de suficiente contraste para su posterior procesamiento. La imagen visionada por la cámara se suele digitalizar y almacenar en memoria de computadora. La imagen digital se denomina un campo de datos de visión y se suele capturar mediante un dispositivo de hardware denominado un captador de trama.

Estos dispositivos son capaces de digitalizar imágenes a una velocidad de 30 cuadros por segundo. Los cuadros están constituidos por una matriz de proyecciones de representación de datos de la escena detectada por la cámara. Los elementos de la matriz se denominan elementos de imagen o píxel. El número de píxel se determina mediante un proceso de muestreo realizado en cada cuadro de imagen. Un píxel individual es la proyección de una pequeña parte de la escena, que reduce esa parte a un valor único. El valor es una medida de la intensidad de luz para ese elemento de la escena. La intensidad de cada píxel se convierte en un valor digital. Este valor corresponde a la función obtenida tras el resultado de la medida o muestreos realizados a intervalos de tiempo espaciados regularmente, siendo el valor de dicha función un número positivo y entero. Los valores que esta función forma en cada punto dependen del brillo que presenta en esos puntos la imagen original.

La matriz de imagen digitalizada para cada cuadro se almacena y luego se somete a las funciones de procesamiento de imágenes y análisis para reducción de datos e interpretación de la imagen. Estos pasos se requieren para permitir la aplicación en tiempo real del análisis de visión requerido en las aplicaciones de robótica. Normalmente, un cuadro de imagen tendrá unos umbrales para obtener una imagen binaria, y luego varias medidas de características reducirán todavía más la representación de datos de la imagen. Esta reducción de datos puede cambiar la representación de un cuadro desde varios centenares de bytes de datos de valores de características. Los datos de característica resultante pueden analizarse en el tiempo disponible para la acción por el sistema robot.

Varias técnicas para calcular los valores de características pueden programarse en la computadora para obtener descriptores de la imagen que están en concordancia con los valores anteriormente calculados, que están almacenados en la computadora. Estos descriptores incluyen las características de forma y tamaño que pueden calcularse con facilidad a partir de la matriz de imágenes con umbrales. Algunas de estas técnicas utilizadas en el procesamiento de imágenes y análisis se examinarán en el capítulo 8 del presente módulo.

Para realizar el procesamiento de imágenes y su análisis, el sistema de visión debe capacitarse con frecuencia. En este proceso se obtiene información sobre los objetos de prototipo y se almacena como modelos de computadora. La información recogida durante la capacitación está constituida por características tales como el área del proyecto, su longitud perimétrica, diámetros mayor y menor y otras características similares. Durante la posterior operación del sistema, los valores calculados en objetos desconocidos visionados por la cámara se comparan con los modelos de computadora para determinar si se produjo una coincidencia. En el capítulo 9 del presente módulo se examinará el adiestramiento de un sistema de visión.

Las aplicaciones actuales de la visión de máquina en la robótica incluyen la inspección, la identificación de piezas, la localización y la orientación. Está en curso, los trabajos de investigación sobre aplicaciones avanzadas de la visión de máquina para su empleo en tareas complejas de inspección, guiado y navegación.

Algunas de las aplicaciones más usuales de visión de máquina son tareas de inspección que no implican el empleo de un robot industrial. Una aplicación típica es aquella en donde el sistema de visión de máquina se instala en una línea de producción de alta velocidad para aceptar o rechazar las piezas fabricadas en la línea. Las piezas no aceptables se sacan fuera de la línea mediante algún dispositivo mecánico, que está comunicado con el sistema de visión.

Se puede considerar que las aplicaciones de visión de máquina tienen tres niveles de dificultad. Estos niveles dependen de si los elementos objeto de visión están controlados en posición o apariencia. El control de la posición de un elemento en un entorno de fabricación suele necesitar un montaje de sujeción preciso. El control de la apariencia de un elemento se realiza mediante las técnicas de iluminación. Los tres niveles de dificultad utilizados para categorizar las aplicaciones de visión de máquina en el ámbito industrial son los siguientes:

- El objeto se puede controlar en posición y apariencia.

- El objeto se puede controlar por posición o apariencia, pero no ambas cosas a la vez.

- El objeto no se puede controlar ni por posición ni por apariencia.

El tercer nivel de dificultad exige capacidades de visión avanzadas. El objetivo de la técnica de las aplicaciones de visión es conseguir el nivel más bajo de dificultad, con lo que se reducirá también el nivel de sofisticación del sistema de visión requerido en la aplicación. Por ejemplo, uno de los problemas que suele surgir en el reconocimiento de un objeto es que el proceso de reconocimiento se facilita si el objeto está en la orientación y posición conocidas. Las piezas en una fábrica no suelen estar situadas de esa forma. Este problema puede reducirse desde un tercer nivel hasta un primer nivel de dificultad mediante la sujeción de las piezas y la utilización de técnicas tales como la iluminación estructurada para controlar la apariencia.

En términos generales, las aplicaciones de la robótica de la visión de máquina están dentro de una de las tres categorías indicadas a continuación:

Haz clic en cada botón para obtener más información

1. Inspección.

En la primera categoría, la función primaria es el proceso de inspección. En este caso, el objetivo de la inspección de visión de máquina se incluye la comprobación de los defectos en bruto de superficies, detección de defectos en etiquetados, medición de la exactitud dimensional y comprobación para detectar la presencia de agujeros y otras características en una pieza. Cuando estas clases de operaciones de inspección se realizan manualmente, existe una tendencia de error. Con la visión de máquina, estos procedimientos se llevan en forma automática, un porcentaje de inspección de 100% y, por norma general, en un tiempo mucho menor.

2. Identificación.

La segunda categoría, la identificación, hace referencia a las aplicaciones en las que el propósito del sistema de visión es reconocer y clasificar un objeto en vez de inspeccionarlo. La inspección implica la aceptación o rechazo de la pieza. La identificación lleva consigo un proceso de reconocimiento en el que la propia pieza, su posición u orientación sea determinada. Entre las aplicaciones de identificación de la visión de máquina se incluyen la clasificación de las piezas, paletización y despaletización y captación de piezas que se orientan de forma aleatoria desde una banda transportadora.

3. Servo presentación visual y navegación.

En la tercera categoría de aplicación, servo presentación visual, el objetivo del sistema de visión es dirigir las acciones del robot basándose en su entrada visual. El ejemplo genérico es donde se utiliza el sistema de visión de máquina para controlar la trayectoria del efector final del robot hacia un objeto dentro del espacio de trabajo. Entre los ejemplos industriales de esta aplicación se incluyen el posicionamiento de una pieza, recuperación de piezas en movimiento a lo largo de un transportador, recuperación y reorientación de piezas en movimiento a lo largo de un transportador, montaje, recogida de recipientes y seguimiento de la costura en la soldadura por arco continua.

6.2 Modelos usados en los sistemas de visión

La meta de los distintos modelos de cámaras es la geometría de la proyección de puntos en 3D, curvas y superficies sobre una superficie 2D, ya sea en el plano de vista o plano imaginario.

Los dos tipos principales de modelos son los siguientes:

- Modelo de lente delgada.

- Modelo pinhole (agujero de alfiler).

Modelo de lente delgada. Las cámaras más modernas utilizan lentes para enfocar la luz sobre la superficie plana. Esto se hace porque de esta manera uno puede capturar suficiente luz en un periodo de tiempo lo suficientemente corto en que los objetos no se mueven apreciablemente, y la imagen es lo suficientemente brillante para mostrar detalles significantes sobre un amplio rango de intensidades y contrastes.

Hay una amplia gama de dispositivos de formación de imágenes disponibles en el mercado. En una cámara convencional, la vista del plano contiene químicos foto reactivos; en nuestro caso hacemos referencia a cámaras de estado sólido para la visión del robot, las cuales incluyen dispositivos acoplados por carga (CCD). Este método se utiliza para obtener una imagen digitalizada (utilizando una cámara digital). En esta tecnología la imagen se proyecta por una cámara de video sobre el CCD, que detecta, almacena y extrae por lectura la carga acumulada generada por la luz en cada parte de la imagen. La detección de la luz se produce mediante la absorción de luz en un substrato fotoconductor (por ejemplo, silicio). Las cargas se acumulan bajo electrodos de control positivos en cubetas aisladas debido a las tensiones aplicadas a los electrodos centrales. Cada cubeta aislada representa un solo píxel y puede transferirse a registros de almacenamiento de salida variando las tensiones en los electrodos de controles metálicos.

Los modelos de lente delgada pueden ser bastante complejos, específicamente para lentes compuestos encontrados en la mayoría de las cámaras. A partir de este punto consideraremos quizás el caso más simple, conocido como el modelo de lente delgada. En este modelo, los rayos de luz emitidos desde un punto viajando a través de un camino recto por la lente, cubren un punto detrás de la lente. La cantidad clave gobernando este comportamiento es llamada como la longitud focal del lente. La longitud focal, puede ser definida como la distancia detrás de los lentes para los cuales los rayos desde una fuente de distancia infinita convergen en un foco.

Modelo pinhole. Está cámara es una idealización de una lente delgada como apertura encogida a cero. La luz desde un punto viaja alrededor de un sencillo camino recto a lo largo de un agujero del tamaño de un orificio de alfiler, sobre la vista plana. El objeto es imaginado al revés sobre el plano de la imagen. Existe otra manera de pensar acerca del modelo pinhole. Suponga que está viendo una escena con un ojo mirando a través de una ventana cuadrada, y dibuje una pintura sobre lo que está viendo a través de la ventana.

La imagen que se obtiene corresponde al dibujo de un rayo desde la posición del ojo e intersectando éste con la ventana. Esto es equivalente al modelo de la cámara pinhole, excepto que el plano de la vista está enfrente del ojo en lugar de estar detrás de él, y la imagen aparece boca arriba, más bien al revés (es decir, el punto del ojo reemplaza el orificio de alfiler). Para observar esto considera el rastreo de rayos desde los puntos de escena a través de la vista de plano detrás del punto del ojo y uno enfrente del, tal como se mostró en la figura anterior.

6.3 Criterio de selección de un sistema de visión.

En los sistemas de visión artificial es necesario utilizar ópticas de calidad para tener la mejor imagen posible y permitir las medidas con la mejor precisión. Para definir el tipo de óptica se deben de seguir una serie de criterios de selección:

- Las especificaciones del sensor de la cámara.

- El tamaño y geometría del objeto.

- La distancia y el espacio disponible.

Así como los elementos que componen las lentes:

- Anillo de enfoque: cuánto más cerca enfocamos, más sobresale el objetivo.

- Diafragma: se enfoca para girar la entrada de luz a la cámara. Su escala suele ser: 16,11, 1.8. A mayor número seleccionado, menor abertura del diafragma y mayor profundidad de campo.

- Velocidad de obturación: selecciona el tiempo que estará abierto el diafragma. Su escala suele ser: 1/1, ½, 1/250, 1/1000. Para obtener imágenes nítidas de objetos que se desplazan a gran velocidad hay que seleccionar velocidades de obturación altas.

- Longitud o distancia focal: valor en milímetros que nos informa la distancia entre el plano focal (CCD) y el centro del objetivo.

- Profundidad de campo: espacio en el cual se ve el objeto totalmente nítido. Depende de la longitud focal de la lente empleada.

- Precisión de la medida: depende exclusivamente del campo de medida y de la resolución de la cámara.

Con base en sus características, las lentes poseen la siguiente clasificación:

Características |

Gran angular

(<50 milímetros) |

Standard

(= 50 milímetros) |

Teleobjetivo

(> 50 milímetros) |

Angulo de visión |

70 grados |

50 grados |

30 grados |

Tamaño |

Pequeño |

Medio |

Grande |

Luminosidad |

Muy luminoso |

Luminoso |

Poco luminoso |

Perspectiva |

Separación de objetos |

Reproducción correcta |

Objetos próximos |

Profundidad de campo |

Muy grande |

Media |

Muy pequeña |

Posibilidades |

Grandes espacios |

Espacios no muy grandes |

Para acercar objetos |

Adicionalmente, es importante considerar la luz visible, el cual es un tipo de radiación electromagnética que puede ser detectado por el ojo humano. Los colores que percibimos en un objeto son determinados por la naturaleza de luz reflejada en dicho objeto.

Luz monocromática: es la luz que no tiene color, su único atributo es su intensidad o cantidad. En general usamos el término nivel de gris para definirla, porque ésta va desde el negro hasta el blanco pasando por una gama de grises.

Luz cromática: es la luz de color, se usan tres cantidades para describir su calidad.

- Radiancia: cantidad total de energía que fluye de una fuente de luz.

- Luminancia: cantidad de energía que un observador percibe de una fuente de luz.

- Brillo: es la iluminación subjetiva, engloba la noción de intensidad.